Transformer (Architettura di Deep Learning)

| Transformer (Architettura di Deep Learning) | |

|---|---|

| Nome Inglese | Transformer |

| Sigla | |

| Anno Di Creazione | 2017 |

| Pubblicazione | Attention Is All You Need (2017) |

| URL | https://arxiv.org/pdf/1706.03762 |

| Topic | Generazione, Reti neurali, Traduzione, Elaborazione del Linguaggio Naturale (NLP), Immagini |

Architettura proposta originariamente sul paper Attention Is All You Need (2017), composta da un Encoder e un Decoder.

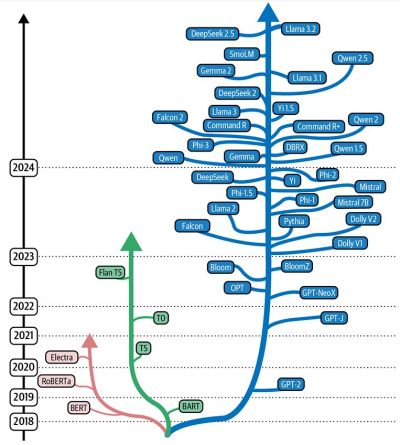

- Vengono chiamati "Transformer Encoder" i modelli bidirezionali (Encoder-Only) come BERT, che utilizzando come obiettivo di pre-training il Masked-Language-Modeling (MLM), necessitano che la rappresentazione fonda sia il contesto a destra che quello a sinistra del token che dev'essere predetto, quindi utilizzano una self-attention bidirezionale

- Vengono chiamati "Transformer Decoder" i modelli che usano un' attention "left-to-right" che quindi per la generazione del token successivo hanno a disposizione solo i token passati

Links

https://github.com/karpathy/minGPT

https://github.com/karpathy/nanoGPT

Un'implementazione di GPT2 in 175 linee di codice python

https://towardsdatascience.com/transformers-141e32e695913B1B - But what is a GPT? Visual intro to transformers

An Introduction to Transformers (Turner)

Coding a GPT with Andrej Karpathy

Introduction to self-attention by John Hewitt

History of language models by Brit Cruise

Paper about examples like the “woman - man”