Stable Diffusion: differenze tra le versioni

Nessun oggetto della modifica |

Nessun oggetto della modifica |

||

| Riga 2: | Riga 2: | ||

E' stato finanziato da Stability AI, ed è stato rilasciato nel 2022. | E' stato finanziato da Stability AI, ed è stato rilasciato nel 2022. | ||

== Principale differenza | == Principale differenza rispetto agli altri modelli di generazione di immagini == | ||

Diversamente da [[VAE]] e [[Generative Adversarial Networks (GAN)]], che generano le immagini in un solo passaggio, Stable Diffusion genera le immagini iterativamente. | Diversamente da [[VAE]] e [[Generative Adversarial Networks (GAN)]], che generano le immagini in un solo passaggio, Stable Diffusion genera le immagini iterativamente. | ||

Versione delle 14:29, 3 mar 2024

Nella sua forma più semplice è un modello text-to-image, dato un prompt testuale, genera un'immagine corrispondente. E' stato finanziato da Stability AI, ed è stato rilasciato nel 2022.

Principale differenza rispetto agli altri modelli di generazione di immagini

Diversamente da VAE e Generative Adversarial Networks (GAN), che generano le immagini in un solo passaggio, Stable Diffusion genera le immagini iterativamente.

Architettura

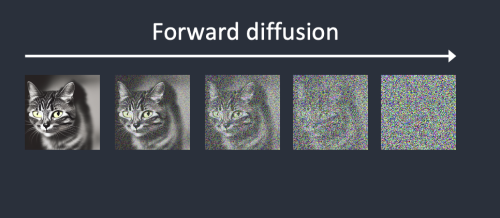

Utilizza un tipo di Modello Di Diffusione, anche chiamato LDM (Modello di Diffusione Latente). Durante il processo di codifica, o Forward Diffusion, un VAE - Variational Autoencoder comprime l'immagine dallo spazio dei pixel a uno spazio latente con meno dimensioni, catturando il significato semantico dell'immagine, da cui il termine LDM (Modello di Diffusione Latente. Lo spazio latente di Stable Diffusion è di dimensioni 4x64x64 per immagini di dimensioni 512x512, 48 volte più piccolo dello spazio originale dei pixel.

In maniera iterativa viene poi aggiunto del rumore gaussiano alle rappresentazioni delle immagini come vettori in questo spazio latente, in step, finchè non diventa rumore bianco. Un tipico numero di iterazioni è 1000. Il processo di Reverse Diffusion rimuove poi il rumore, attraverso l'utilizzo di un modello U-Net a cui si insegna a predire quanto rumore è stato aggiunto ad ogni passo. Infine, la parte Decoder del VAE - Variational Autoencoder viene utilizzata per creare i valori dei pixel dallo spazio latente.

La parte di condizionamento, derivante dal prompt, utilizza la codifica dei token - creta utilizzando il tokenizer CLIP di OpenAI in embedding (dimensione 768 per AUTOMATIC1111), fino a un numero massimo di 75 token. Questi embedding vengono poi utilizzati per "indirizzare" il modello di Reverse Diffusion verso immagini che contengono ciò che viene richiesto nel prompt.

Addestramento

Addestramento

Inizialmente introdotto nel paper Taming Transformers for High-Resolution Image Synthesis (23/06/2021).

Taming Transformers for High-Resolution Image Synthesis