Rete Generativa Avversaria: differenze tra le versioni

Nessun oggetto della modifica |

Nessun oggetto della modifica |

||

| Riga 16: | Riga 16: | ||

L'addestramento massimizza la probabilità che D faccia un'errore di discriminazione, quindi massimizzando la "bravura" di G nel creare dei falsi realistici. | L'addestramento massimizza la probabilità che D faccia un'errore di discriminazione, quindi massimizzando la "bravura" di G nel creare dei falsi realistici. | ||

=== Funzionamento === | |||

L'addestramento del modello cerca di insegnare al Generatore a scalare e traslare i dati contenuti nel vettore di rumore dato in input, la cui lunghezza (spesso da 100 a 512 punti) rappresenta la dimensione dello spazio latente e quindi la capacità della rete di imparare i dettaglio più fini del dataset di training (normalmente rappresentante una classe di immagini omogenea), verso il "''manifold''" che rappresenta la distribuzione di probabilità dei campioni veri. | |||

Partendo dal vettore di input, il generatore applica delle funzionin non lineari di up-scaling per aumentare il numero di dimensioni. | |||

Il Discriminatore, invece, impara in modo supervisionato a riconoscere i campioni veri da quelli finti, e ha come output una sola classe, la probabilità che essi siano veri: per questo è normalmente implementato come una delle classiche [[Reti Neurali Convoluzionali (CNN)|CNN]] che sono in letteratura. | |||

La [[Funzione Obiettivo (loss)|loss]] del generatore è l' [[entropia incrociata]] fra il risultato del Discriminatore e un vettore di uno. | |||

[[File:Generativa Adversarial Network (GAN).png|miniatura|nessuno|600x600px|Generative Adversarial Networks (GAN)]] | [[File:Generativa Adversarial Network (GAN).png|miniatura|nessuno|600x600px|Generative Adversarial Networks (GAN)]] | ||

Versione delle 07:47, 20 apr 2024

Nome: Rete Generativa Avversaria

Nome Inglese: Generative Adversarial Network

Sigla: GAN

Anno Di Creazione: 2014

Pubblicazione: Generative Adversarial Nets

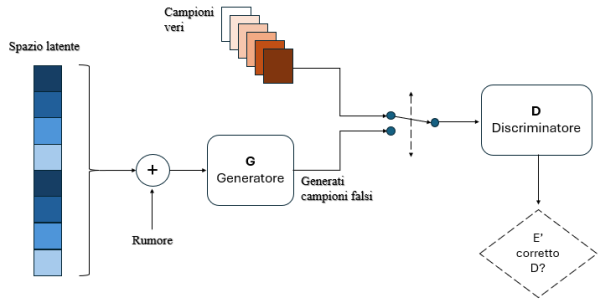

Un'architettura di rete neurale generativa in cui si utilizza un processo di tipo "adversarial", in cui vengono contemporaneamente allenati due modelli:

- un modello generativo G che cattura la distribuzione dei dati di training

- un modello discriminativo D che stima la probabilità che un campione provenga dal dataset di training piuttosto che da G

L'addestramento massimizza la probabilità che D faccia un'errore di discriminazione, quindi massimizzando la "bravura" di G nel creare dei falsi realistici.

Funzionamento

L'addestramento del modello cerca di insegnare al Generatore a scalare e traslare i dati contenuti nel vettore di rumore dato in input, la cui lunghezza (spesso da 100 a 512 punti) rappresenta la dimensione dello spazio latente e quindi la capacità della rete di imparare i dettaglio più fini del dataset di training (normalmente rappresentante una classe di immagini omogenea), verso il "manifold" che rappresenta la distribuzione di probabilità dei campioni veri.

Partendo dal vettore di input, il generatore applica delle funzionin non lineari di up-scaling per aumentare il numero di dimensioni.

Il Discriminatore, invece, impara in modo supervisionato a riconoscere i campioni veri da quelli finti, e ha come output una sola classe, la probabilità che essi siano veri: per questo è normalmente implementato come una delle classiche CNN che sono in letteratura.

La loss del generatore è l' entropia incrociata fra il risultato del Discriminatore e un vettore di uno.

Links

Generative Adversarial Nets, Goodfellow et al, 2014

"A Style-Based Generator Architecture for Generative Adversarial Networks"

"Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks"

GAN Lab - Play with Generative Adversarial Networks (GANs) in your browser