Stable Diffusion: differenze tra le versioni

Nessun oggetto della modifica |

Nessun oggetto della modifica |

||

| (48 versioni intermedie di 5 utenti non mostrate) | |||

| Riga 1: | Riga 1: | ||

{{Template modello | |||

|NomeInglese=Stable Diffusion | |||

|AnnoDiCreazione=2022 | |||

|VersioneCorrente=SD3 (2023) | |||

|Pubblicazione=High-Resolution Image Synthesis with Latent Diffusion Models | |||

}} | |||

Modello per la generazione di immagini open-source rilasciato da Stability AI, basato sul [[Modello di Diffusione Latente (LDM)|modello di diffusione]] : la prima versione risale al 22 agosto 2022. Diversamente da [[VAE]] e [[Generative Adversarial Networks (GAN)]], che generano le immagini in un solo passaggio, Stable Diffusion genera le immagini iterativamente. | |||

Il paper originale è [[High-Resolution Image Synthesis with Latent Diffusion Models (Giugno 2022)]]. | |||

* Versione 1: immagini 512x512 | |||

* Versione 2: immagini 768x768 (09/2022) | |||

* [https://huggingface.co/stabilityai/stable-diffusion-xl-base-1.0 Versione XL (SDXL)]: immagini 1024x1024 (07/2023) | |||

== Architettura == | == Architettura == | ||

Utilizza un tipo di [[Modello Di Diffusione]], anche chiamato [[LDM (Modello di Diffusione Latente]] | Utilizza un tipo di [[Modello Di Diffusione]], anche chiamato [[LDM (Modello di Diffusione Latente)]]. | ||

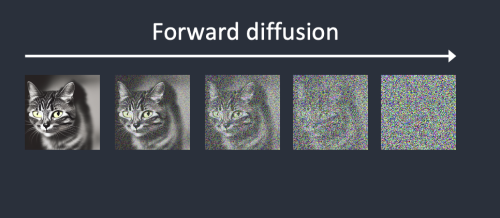

Durante il processo di codifica, o [[Forward Diffusion]], un [[VAE - Variational Autoencoder]] comprime l'immagine dallo spazio dei pixel a uno spazio latente con meno dimensioni, catturando il significato semantico dell'immagine, da cui il termine [[LDM (Modello di Diffusione Latente)]]. Lo spazio latente di Stable Diffusion è di dimensioni 4x64x64 per immagini di dimensioni 512x512, 48 volte più piccolo dello spazio originale dei pixel. | |||

[[File:forward-diffusion.png|500px]] | [[File:forward-diffusion.png|500px]] | ||

In maniera iterativa viene poi aggiunto del rumore gaussiano alle rappresentazioni delle immagini come vettori in questo spazio latente, in step, finchè non diventa rumore bianco. Un tipico numero di iterazioni è 1000. | In maniera iterativa viene poi aggiunto del rumore gaussiano alle rappresentazioni delle immagini come vettori in questo spazio latente, in step, finchè non diventa rumore bianco. Un tipico numero di iterazioni è 1000. | ||

Il processo di [[Reverse Diffusion]] rimuove poi il rumore, attraverso l'utilizzo di un modello [[U-Net]] a cui si insegna a predire quanto rumore è stato aggiunto ad ogni passo. Infine, la parte Decoder del [[VAE - Variational Autoencoder]] viene utilizzata per creare i valori dei pixel dallo spazio latente. | |||

La parte di condizionamento, derivante dal prompt, utilizza la codifica dei token - creta utilizzando il tokenizer [[CLIP]] di [[OpenAI]] in [[embedding]] (dimensione 768 per AUTOMATIC1111), fino a un numero massimo di 75 token. Questi embedding vengono poi utilizzati per "indirizzare" il modello di [[Reverse Diffusion]] verso immagini che contengono ciò che viene richiesto nel prompt. | |||

Stable Diffusion è quindi un modello di diffusione '''latente'''. Invece di operare nello spazio vettoriale dell'immagine (che per un'immagine 512 x 512 con tre canali colore richiederebbe uno spazio composto da 786,432 dimensioni!), comprime l'immagine rappresentandola in uno spazio latente. Lo spazio latente risulta 48 volte più piccolo e per questo il calcolo è alleggerito e molto più veloce di quello di altri modelli come Imagen di Google e [[Dall-e 3 (2023)]] di [[OpenAI]]. | |||

L'addestramento, secondo Wikipedia, è stato eseguito utilizzanto [[LAION-5B]]. | |||

=== Tasks di Stable Diffusion === | |||

* [[Txt2img (Stable Diffusion)]] | |||

* [[img2img]] | |||

* [[Extras]] | |||

=== Links === | |||

==== Papers ==== | |||

* [[High-Resolution Image Synthesis with Latent Diffusion Models (Giugno 2022)]]: paper originale | |||

* [https://arxiv.org/abs/2012.09841 Taming Transformers for High-Resolution Image Synthesis] | |||

Taming Transformers for High-Resolution Image Synthesis | ==== Github ==== | ||

* [https://github.com/layerdiffusion/LayerDiffusion Transparent Image Layer Diffusion using Latent Transparency] | |||

* [https://github.com/layerdiffusion/sd-forge-layerdiffusion?tab=readme-ov-file Transparent Image Layer Diffusion using Latent Transparency (WIP extension for SD WebUI)] | |||

* [https://github.com/lllyasviel/stable-diffusion-webui-forge Platform built on top of Stable Diffusion WebUI (based on Gradio)] | |||

* [https://github.com/AUTOMATIC1111/stable-diffusion-webui?tab=readme-ov-file A web interface for Stable Diffusion, implemented using Gradio library] | |||

* [https://github.com/Stability-AI/stablediffusion Official repo contains Stable Diffusion models trained from scratch and will be continuously updated with new checkpoints] | |||

* [https://github.com/CompVis/taming-transformers Taming Transformers for High-Resolution Image Synthesis] | |||

== | ==== Tutorial ==== | ||

* [https://stable-diffusion-art.com/how-stable-diffusion-work/ How Stable Diffusion Work] | * [https://stable-diffusion-art.com/how-stable-diffusion-work/ How Stable Diffusion Work] | ||

* [https://pub.towardsai.net/diffusion-models-vs-gans-vs-vaes-comparison-of-deep-generative-models-67ab93e0d9ae Diffusion Models vs. GANs vs. VAEs: Comparison of Deep Generative Models] | * [https://pub.towardsai.net/diffusion-models-vs-gans-vs-vaes-comparison-of-deep-generative-models-67ab93e0d9ae Diffusion Models vs. GANs vs. VAEs: Comparison of Deep Generative Models] | ||

* [https://www.youtube.com/watch?v=MXmacOUJUaw&t=1s Stable Diffusion Illustrated] | |||

[[Category:modello]] | |||

{{#seo: | |||

|title=Stable Diffusion | |||

|title_mode=append | |||

|keywords=intelligenza artificiale, apprendimento automatico, modello di diffusione, generazione di immagini, Stable Diffusion, LDM, VAE, GAN, open source, Stability AI, CLIP, embedding, Txt2img, img2img | |||

|description=Stable Diffusion è un modello di intelligenza artificiale open-source per la generazione di immagini, rilasciato da Stability AI nel 2022. Basato sul modello di diffusione latente (LDM), genera immagini di alta qualità in modo iterativo, a differenza di VAE e GAN. Questo articolo esplora l'architettura, le varie versioni, i task e i link utili per Stable Diffusion. | |||

|image=forward-diffusion.png | |||

}} | |||

Versione attuale delle 16:26, 17 ago 2024

| Stable Diffusion | |

|---|---|

| Nome Inglese | Stable Diffusion |

| Sigla | |

| Anno Di Creazione | 2022 |

| Versione Corrente | SD3 (2023) |

| URL | |

| Pubblicazione | High-Resolution Image Synthesis with Latent Diffusion Models |

| URL Pubblicazione | |

Modello per la generazione di immagini open-source rilasciato da Stability AI, basato sul modello di diffusione : la prima versione risale al 22 agosto 2022. Diversamente da VAE e Generative Adversarial Networks (GAN), che generano le immagini in un solo passaggio, Stable Diffusion genera le immagini iterativamente.

Il paper originale è High-Resolution Image Synthesis with Latent Diffusion Models (Giugno 2022).

- Versione 1: immagini 512x512

- Versione 2: immagini 768x768 (09/2022)

- Versione XL (SDXL): immagini 1024x1024 (07/2023)

Architettura

Utilizza un tipo di Modello Di Diffusione, anche chiamato LDM (Modello di Diffusione Latente). Durante il processo di codifica, o Forward Diffusion, un VAE - Variational Autoencoder comprime l'immagine dallo spazio dei pixel a uno spazio latente con meno dimensioni, catturando il significato semantico dell'immagine, da cui il termine LDM (Modello di Diffusione Latente). Lo spazio latente di Stable Diffusion è di dimensioni 4x64x64 per immagini di dimensioni 512x512, 48 volte più piccolo dello spazio originale dei pixel.

In maniera iterativa viene poi aggiunto del rumore gaussiano alle rappresentazioni delle immagini come vettori in questo spazio latente, in step, finchè non diventa rumore bianco. Un tipico numero di iterazioni è 1000. Il processo di Reverse Diffusion rimuove poi il rumore, attraverso l'utilizzo di un modello U-Net a cui si insegna a predire quanto rumore è stato aggiunto ad ogni passo. Infine, la parte Decoder del VAE - Variational Autoencoder viene utilizzata per creare i valori dei pixel dallo spazio latente.

La parte di condizionamento, derivante dal prompt, utilizza la codifica dei token - creta utilizzando il tokenizer CLIP di OpenAI in embedding (dimensione 768 per AUTOMATIC1111), fino a un numero massimo di 75 token. Questi embedding vengono poi utilizzati per "indirizzare" il modello di Reverse Diffusion verso immagini che contengono ciò che viene richiesto nel prompt.

Stable Diffusion è quindi un modello di diffusione latente. Invece di operare nello spazio vettoriale dell'immagine (che per un'immagine 512 x 512 con tre canali colore richiederebbe uno spazio composto da 786,432 dimensioni!), comprime l'immagine rappresentandola in uno spazio latente. Lo spazio latente risulta 48 volte più piccolo e per questo il calcolo è alleggerito e molto più veloce di quello di altri modelli come Imagen di Google e Dall-e 3 (2023) di OpenAI.

L'addestramento, secondo Wikipedia, è stato eseguito utilizzanto LAION-5B.

Tasks di Stable Diffusion

Links

Papers

- High-Resolution Image Synthesis with Latent Diffusion Models (Giugno 2022): paper originale

- Taming Transformers for High-Resolution Image Synthesis

Github

- Transparent Image Layer Diffusion using Latent Transparency

- Transparent Image Layer Diffusion using Latent Transparency (WIP extension for SD WebUI)

- Platform built on top of Stable Diffusion WebUI (based on Gradio)

- A web interface for Stable Diffusion, implemented using Gradio library

- Official repo contains Stable Diffusion models trained from scratch and will be continuously updated with new checkpoints

- Taming Transformers for High-Resolution Image Synthesis

Tutorial

- How Stable Diffusion Work

- Diffusion Models vs. GANs vs. VAEs: Comparison of Deep Generative Models

- Stable Diffusion Illustrated